简介

GPT4All 是一个生态系统,用于运行功能强大且定制的大型语言模型,这些模型可在消费级 CPU 和任何 GPU 上本地运行。

GPT4All 模型是一个 3GB – 8GB 的文件,您可以下载并插入 GPT4All 开源生态系统软件。Nomic AI 支持和维护这个软件生态系统,以加强质量和安全性,同时带头让任何人或企业轻松训练和部署自己的边缘大型语言模型。

系统要求

Apple OS X 10.6.8(雪豹的更新版本)及更高,Linux 2.6.30 内核以后,以及Windows 7 SP1(Service Pack 1) KB976932,Windows Server 2008 R2 SP1、Windows 8、Windows 10及以上。

功能

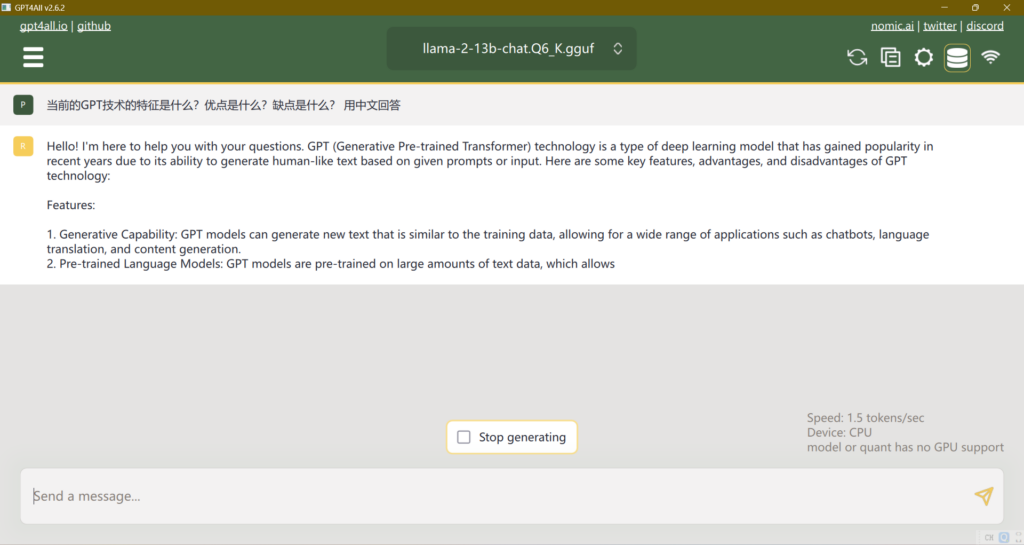

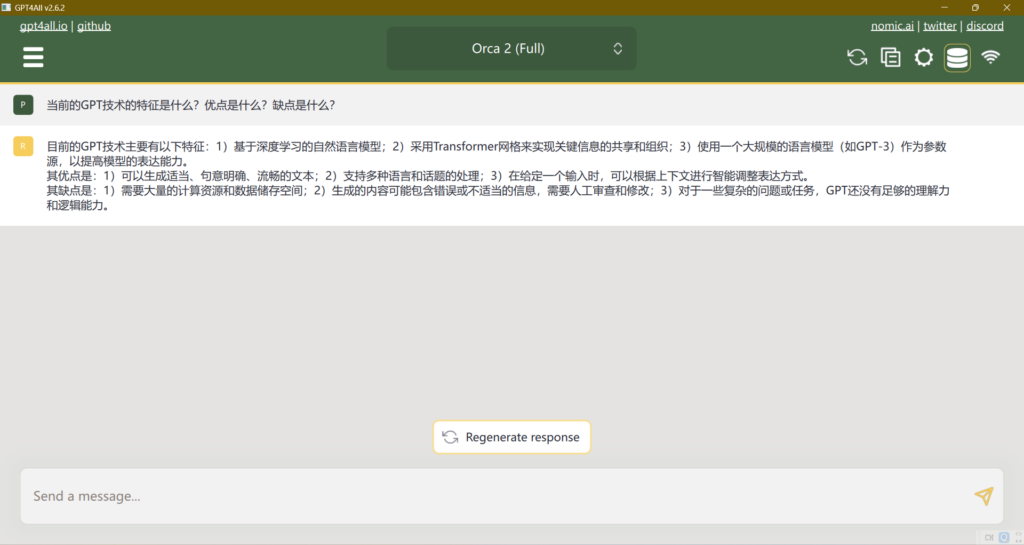

1、回答有关世界的问题

向 GPT4All 询问任何事情。

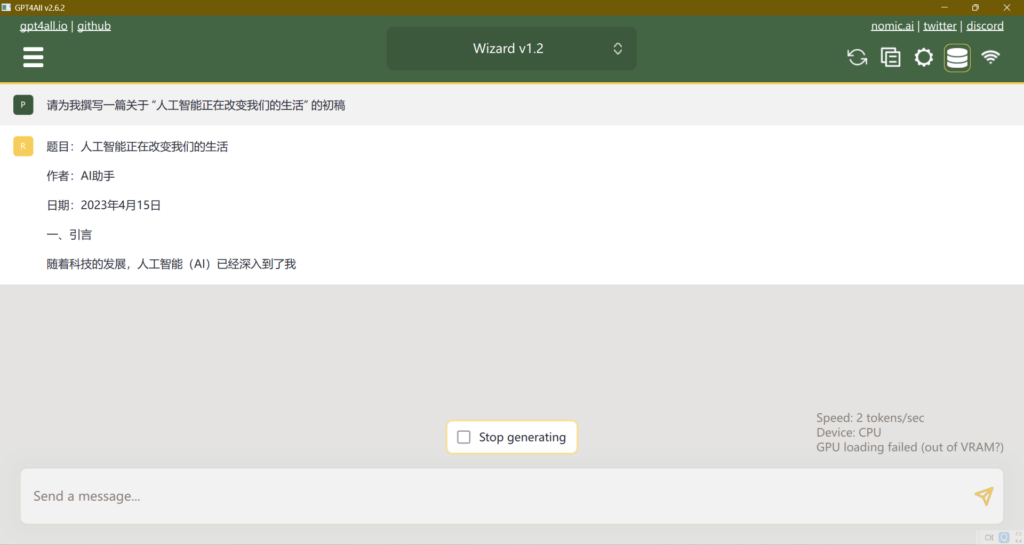

2、个人写作助理

撰写电子邮件、文档、创意故事、诗歌、歌曲和戏剧。

3、了解文档

提供您自己的文本文档,并接收有关其内容的摘要和答案。

4、编写代码

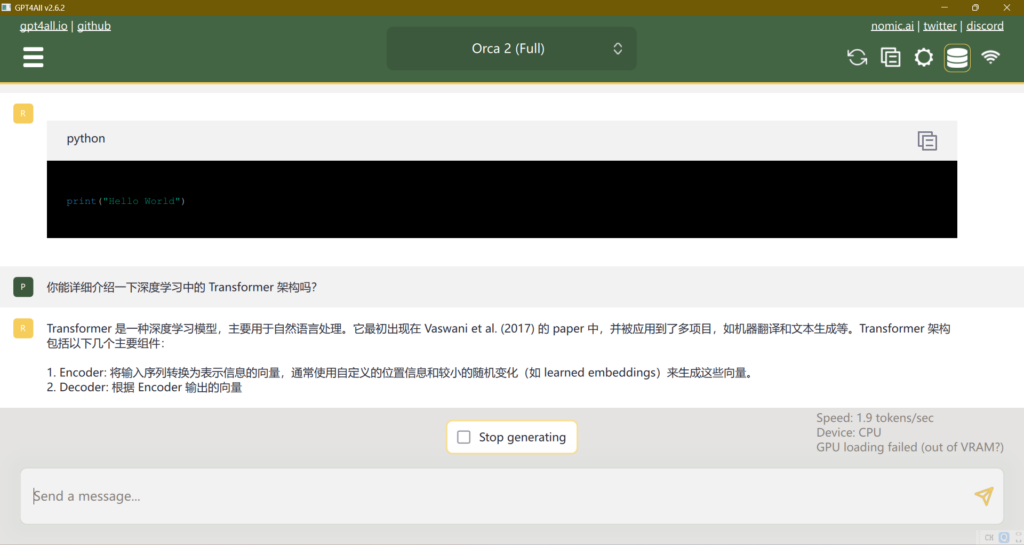

获取有关简单编码任务的指导。代码功能正在改进中。

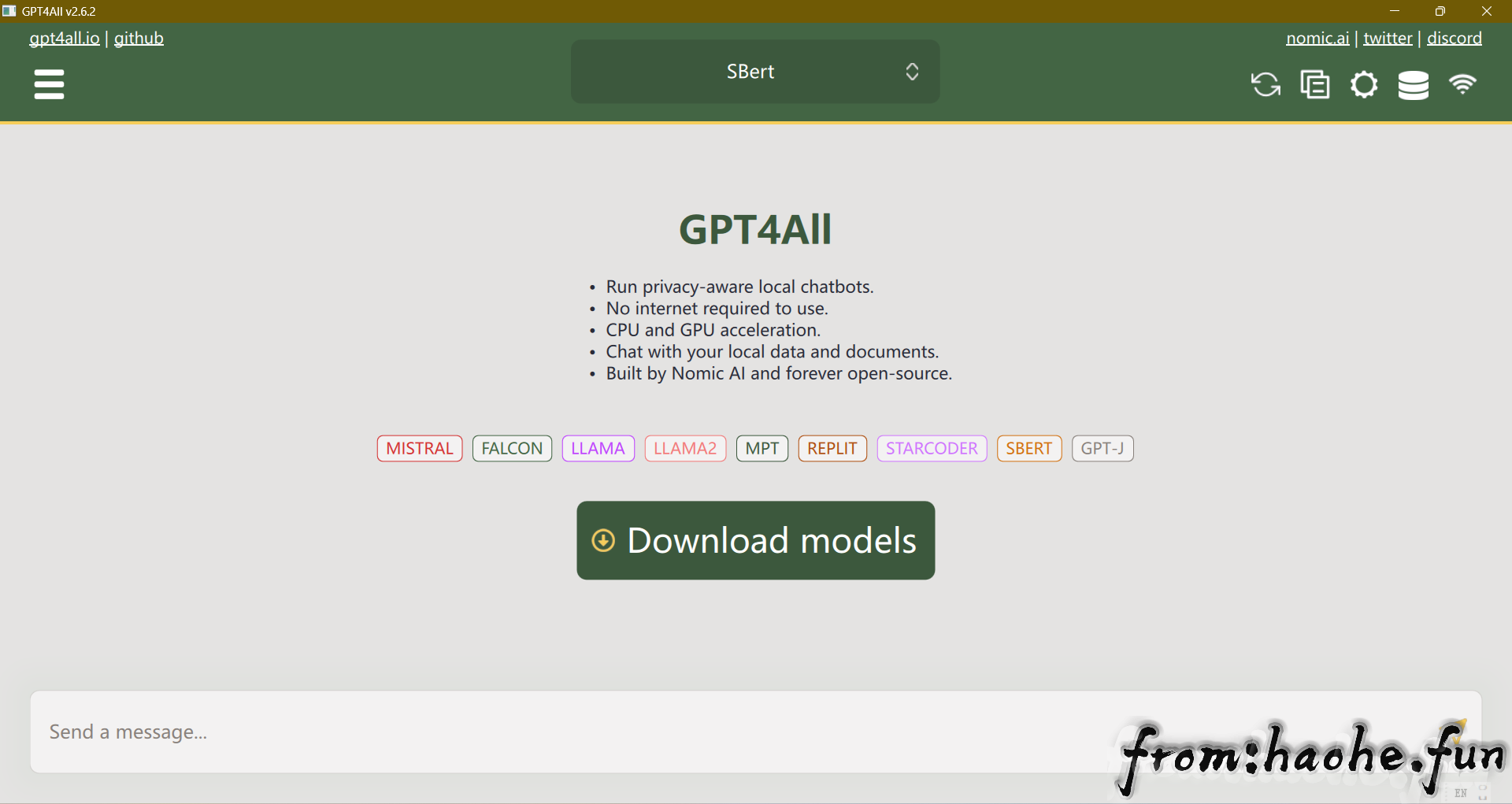

支持的模型

目前,支持六种不同的模型架构:

- GPT-J – 基于 GPT-J 架构,示例可在此处找到

- LLaMA – 基于 LLaMA 架构,并提供此处的示例

- MPT – 基于 Mosaic ML 的 MPT 架构,示例可在此处找到

- Replit – 基于 Replit Inc. 的 Replit 架构,示例可在此处找到

- Falcon – 基于 TII 的 Falcon 架构,示例可在此处找到

- StarCoder – 基于 BigCode 的 StarCoder 架构,示例可在此处找到

安装

官方提供Windows、MacOS、Ubuntu的安装包,安装后直接使用。

使用

模型

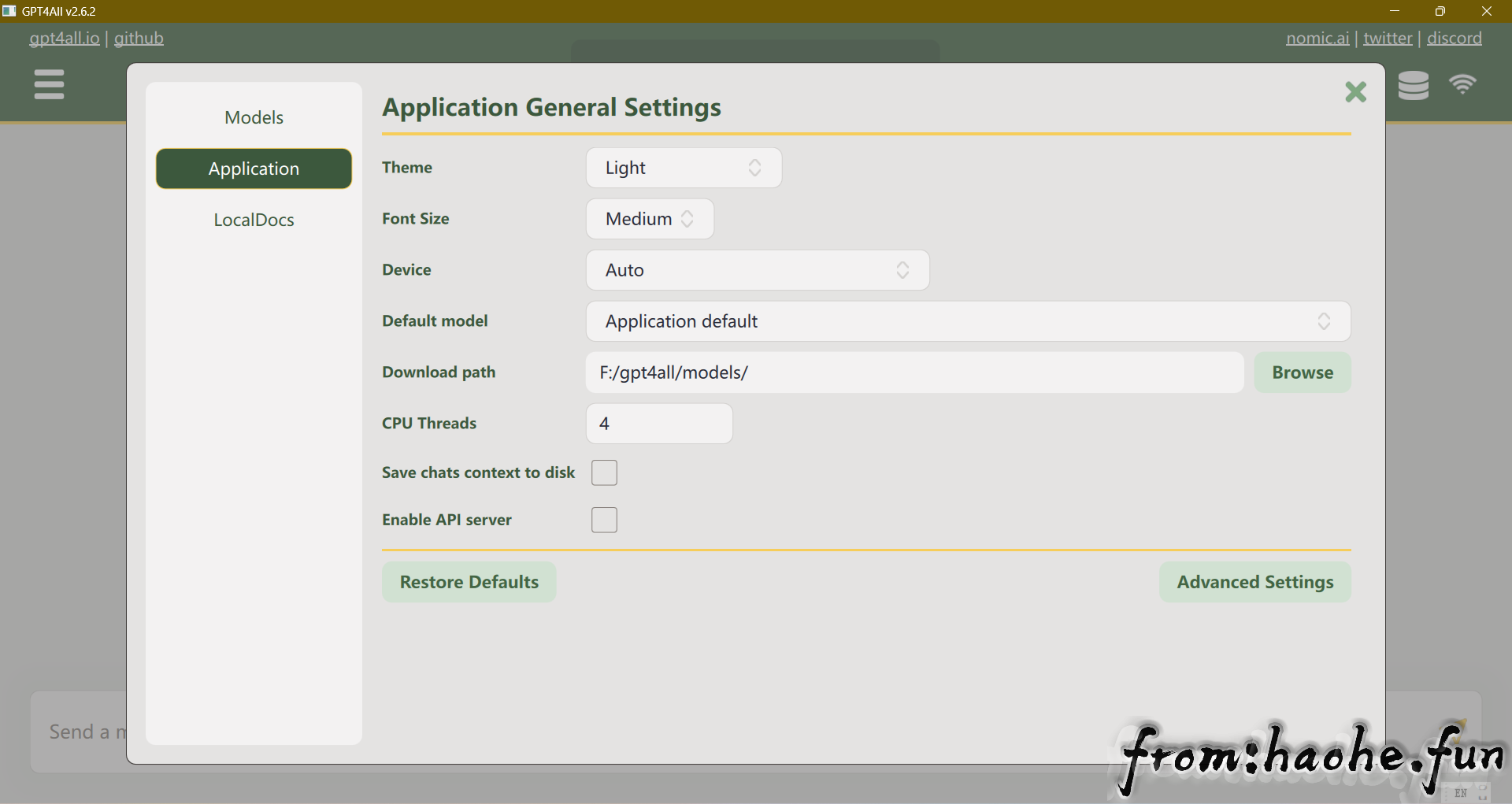

安装后打开软件,第一次使用会提示安装模型,先在设置里面更改模型下载目录,建议更改到系统盘以外的盘符。

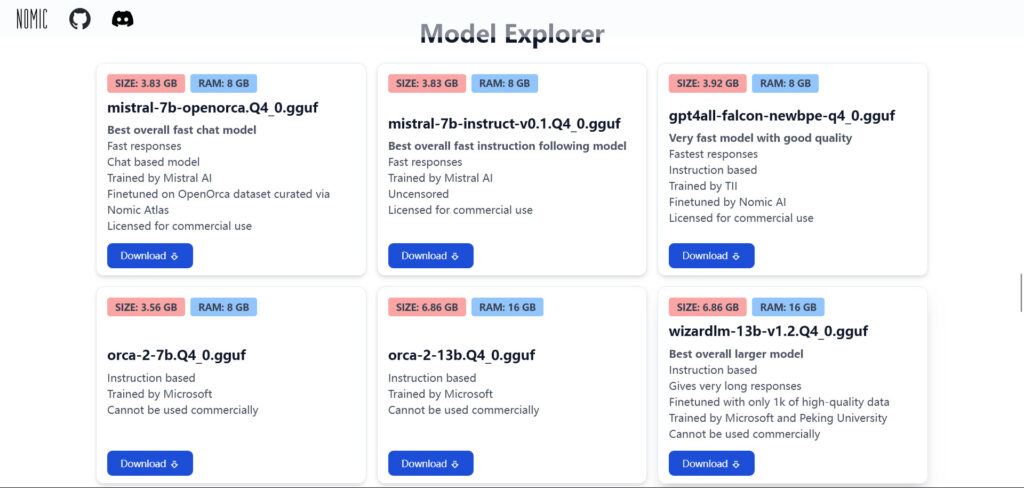

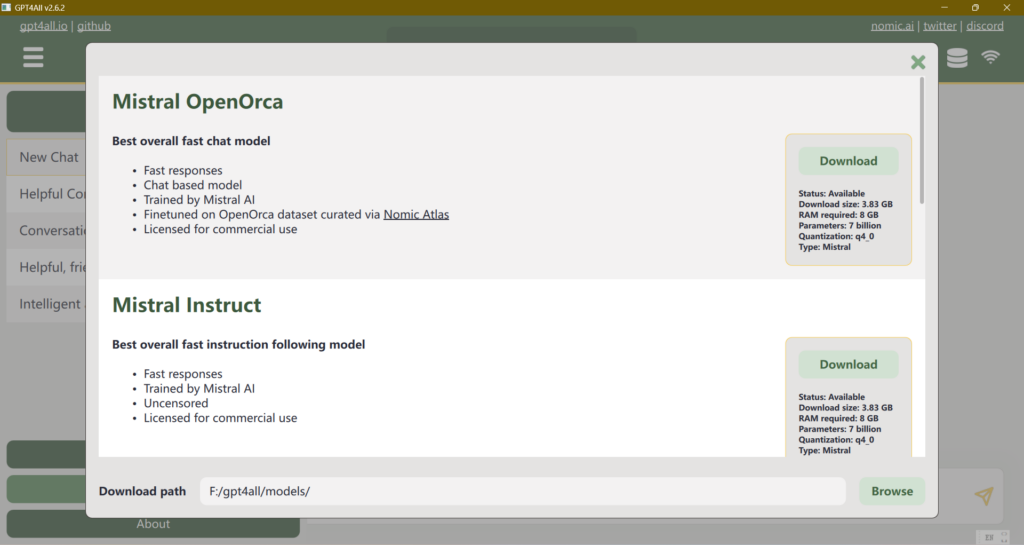

然后在软件里面下载模型或者在官网下载模型,上面有简介、模型大小、内存要求、参数、作者、是否商用等信息,软件中下的直接可以用,官网下载的把模型移动到刚才设置的模型目录中,或者也可以加载其他gguf格式的支持的模型文件,重新启动软件即可自动识别。然后就可以自由使用了。在聊天框上方可以切换模型。

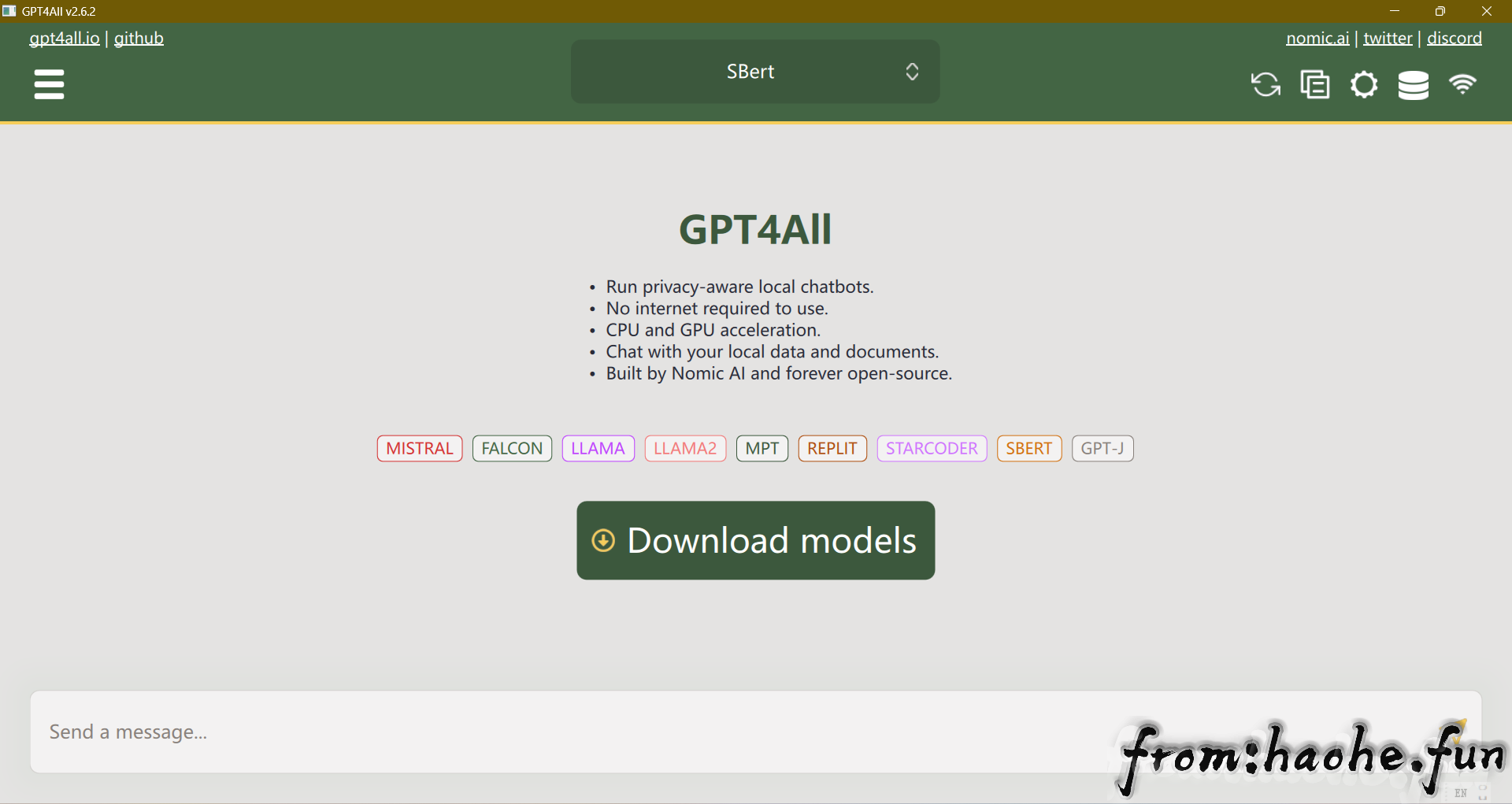

LocalDocs 插件(与您的数据聊天)

LocalDocs 是一项 GPT4All 功能,可让您与本地文件和数据聊天。它允许您利用强大的本地LLMs功能与私人数据聊天,而无需任何数据离开您的计算机或服务器。使用 LocalDocs 时,您将LLM引用最有可能对给定输出做出贡献的来源。请注意,即使LLM配备了 LocalDocs 也会产生幻觉。LocalDocs 插件将利用您的文档来帮助回答提示,您会看到参考出现在响应下方。

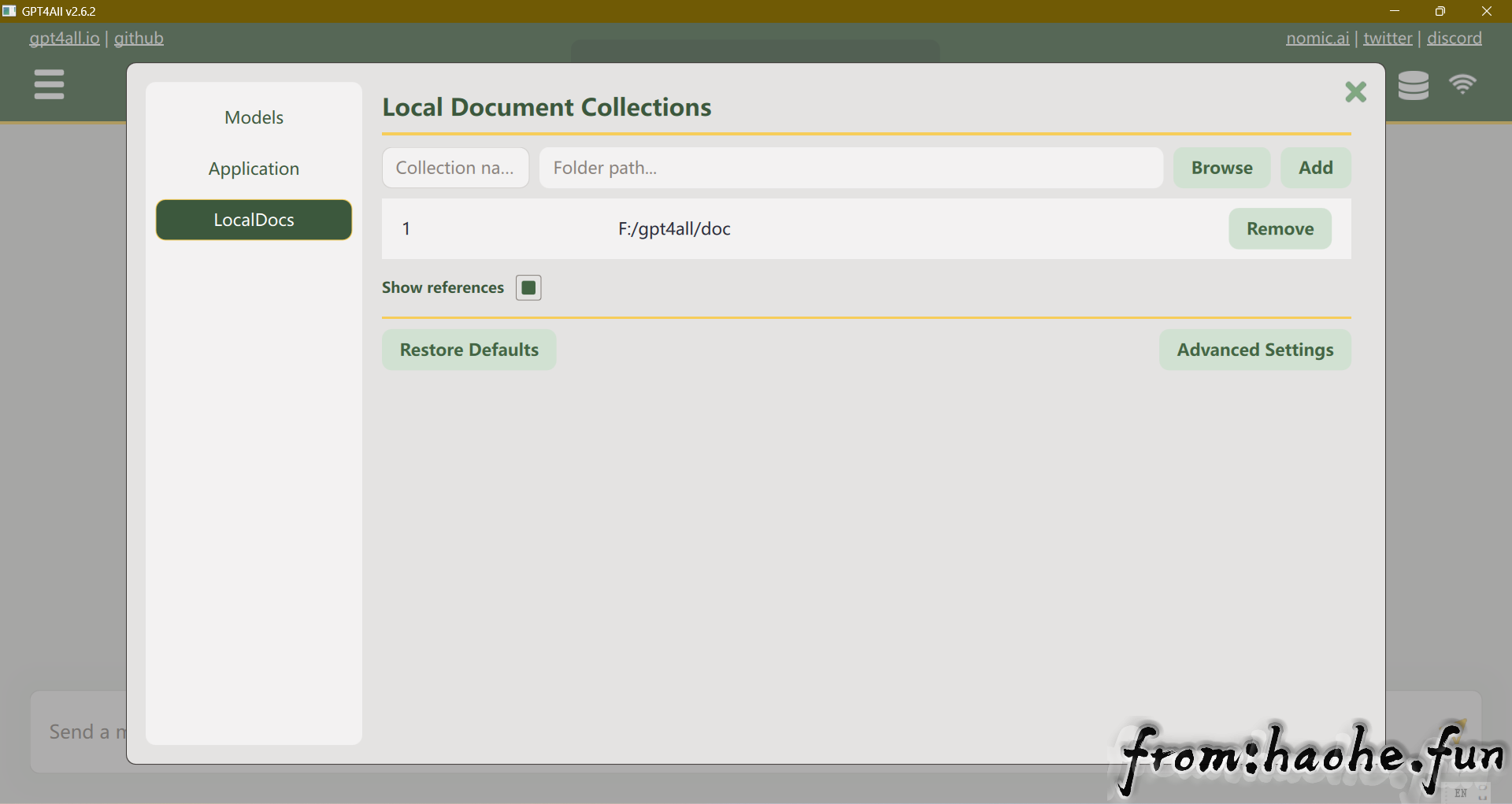

启用 LocalDocs

1、下载 SBert 模型

2、在计算机上配置一个集合(文件夹),其中包含您LLM应有权访问的文件。您可以随时更改文件夹/目录的内容。当您将更多文件添加到您的收藏中时,您将LLM能够动态地访问它们。

3、在右上角,单击数据库图标,然后选择您希望在LLM聊天会话期间了解的集合。

LocalDocs可以根据您的提示/问题查询您的文件。系统将搜索您的文档,以查找可用于为答案提供上下文的片段。最相关的片段将插入到提示上下文中,但由基础模型决定如何最好地使用提供的上下文。

LocalDocs不能回答一般元数据查询、总结单个文档。

截图

下载地址

windows:https://gpt4all.io/installers/gpt4all-installer-win64.exe

MacOS:https://gpt4all.io/installers/gpt4all-installer-darwin.dmg

Ubuntu:https://gpt4all.io/installers/gpt4all-installer-linux.run